Apple ha mostrado un avance de sus nuevas prestaciones de software enfocadas a la accesibilidad cognitiva, visual, auditiva y de motricidad junto con innovadoras herramientas para personas que han perdido o están en riesgo de perder el habla. Estas prestaciones se basan en los avances de hardware y software y utilizan el aprendizaje automático de los dispositivos para garantizar la privacidad de los usuarios, ampliando el compromiso de Apple de diseñar productos para todo el mundo.

Apple trabaja estrechamente con colectivos que representan a usuarios con todo tipo de discapacidades para desarrollar prestaciones de accesibilidad que mejoren la vida de las personas. Más adelante este mismo año, los usuarios con discapacidades cognitivas podrán utilizar el iPhone y el iPad con más facilidad y autonomía gracias a Assistive Access; las personas que han perdido el habla podrán utilizar Live Speech para que los textos que escriban se puedan escuchar en sus llamadas y conversaciones, y los que estén en riesgo de perder el habla podrán crear una voz sintetizada similar a la suya para comunicarse con familiares y amigos. Los usuarios ciegos o con visión reducida podrán utilizar Point and Speak en el modo de detección en Lupa, una prestación que identifica un determinado texto para leerlo en voz alta y facilitar la interacción con objetos físicos como pueden ser los electrodomésticos.

«En Apple siempre hemos creído que la mejor tecnología es aquella que es accesible a todo el mundo», ha dicho Tim Cook, CEO de Apple. «Nos emociona presentar nuevas e increíbles prestaciones que se basan en nuestra larga historia de hacer que la tecnología sea accesible, para que todas las personas tengan la oportunidad de crear, comunicarse y hacer lo que más le gusta».

«La accesibilidad es una parte fundamental de todo lo que hacemos en Apple», ha dicho Sarah Herrlinger, directora sénior de Iniciativas y Políticas Globales de Accesibilidad de Apple. «Estas revolucionarias prestaciones se han diseñado con la participación de personas con diferentes discapacidades a lo largo de todo el proceso, para poder dar apoyo a las diferentes comunidades de usuarios y ayudar a las personas a mantenerse conectadas a través de nuevas formas».

Assistive Access ayuda a los usuarios con discapacidades cognitivas

Assistive Access recurre a las innovaciones en el diseño para simplificar al máximo las apps y el uso de las mismas para reducir su carga cognitiva. Estas prestaciones se han creado a partir de las aportaciones de personas con discapacidades cognitivas y las personas que les ayudan en el día a día, centrándose en sus actividades favoritas y permitiéndoles utilizar el iPhone y el iPad para lo que han sido diseñados: comunicarse con sus seres queridos, hacer fotos, disfrutar de ellas y escuchar música.

Assistive Access personaliza la experiencia con Teléfono y FaceTime, que se han combinado en la app Calls, y también con Mensajes, Cámara, Fotos y Música. La prestación incluye una interfaz especialmente diseñada con botones de alto contraste y recuadros de texto más grandes, además de herramientas pensadas para que los asistentes de las personas con discapacidades cognitivas adapten la experiencia a las necesidades individuales de cada usuario. Por ejemplo, si un usuario prefiere comunicarse de forma visual, Mensajes incluirá un teclado únicamente de emoji permitiéndoles grabar un vídeo mensaje para compartir con sus seres queridos. Los usuarios y las personas que les asisten también podrán elegir entre un diseño más visual en cuadrícula para su pantalla de inicio y las apps, u otro basado en filas si prefieren un formato de texto.

«Hay personas con discapacidades intelectuales y del desarrollo que son muy creativas, pero la tecnología suele implicar obstáculos físicos, visuales y cognitivos para estas personas», ha dicho Katy Schmid, directora sénior de Programas e Iniciativas Nacionales en la organización estadounidense The Arc. «El hecho de que el iPhone y el iPad incorporen prestaciones enfocadas a la accesibilidad cognitiva abre más puertas en los ámbitos de la educación, el empleo, la seguridad y la autonomía. Es algo que amplía tanto los horizontes como el potencial».

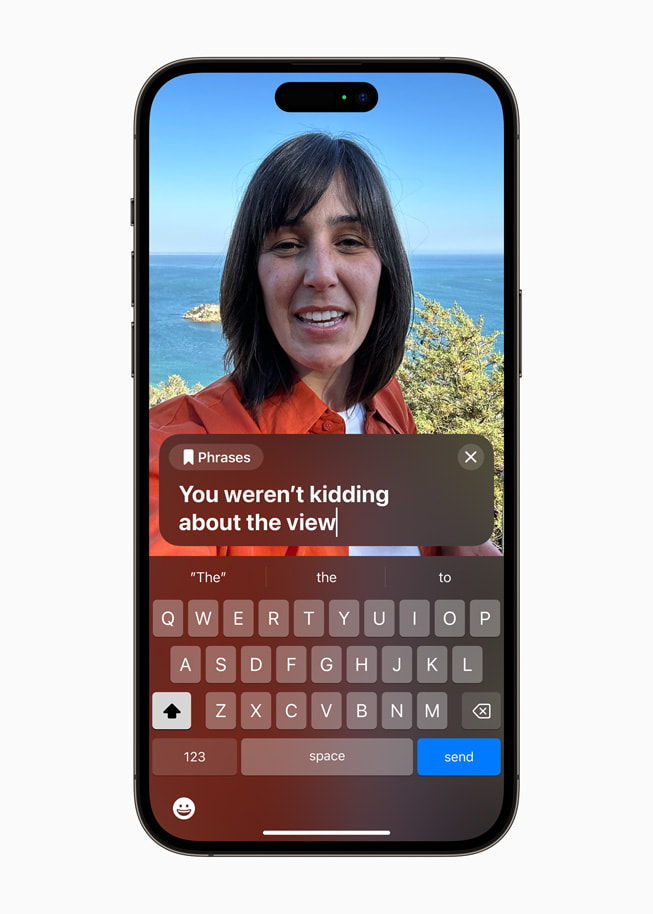

Prestaciones de habla avanzadas: Live Speech y Personal Voice

Con Live Speech en el iPhone, el iPad y el Mac, los usuarios podrán escribir lo que quieran decir para que se reproduzca en voz alta durante las llamadas de teléfono y FaceTime o sus conversaciones en persona. Los usuarios también podrán guardar las frases que más utilizan para añadirlas al momento cuando se comuniquen con familiares, amigos o compañeros de trabajo. Live Speech se ha diseñado para ayudar a millones de personas de todo el mundo que no pueden hablar o han perdido el habla con el paso del tiempo.

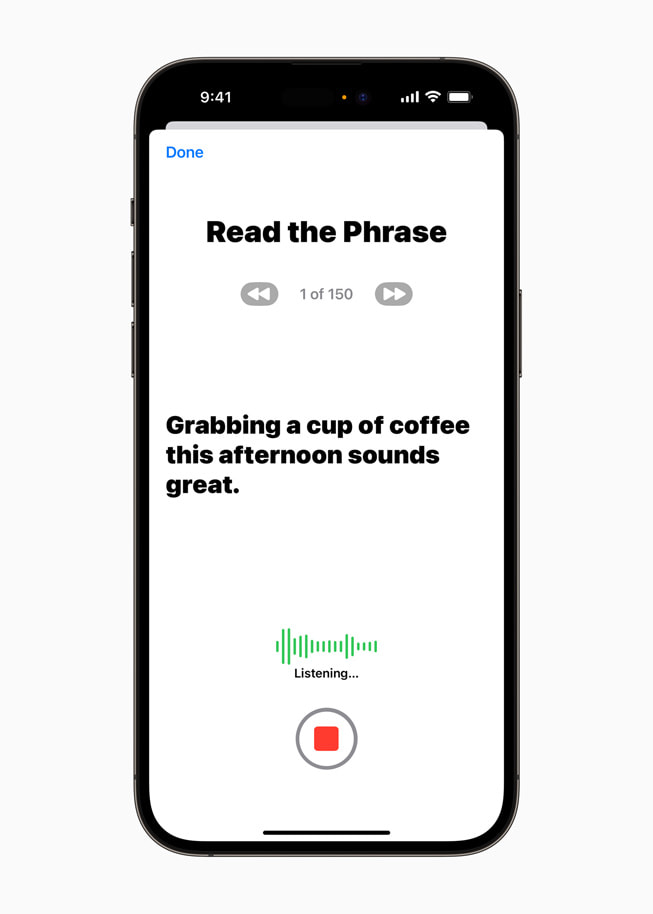

Gracias a Personal Voice, los usuarios podrán crear una voz similar a la suya de una forma fácil y segura, algo especialmente útil si están en riesgo de perder el habla debido a un diagnóstico reciente de esclerosis lateral amiotrófica (ELA) u otra enfermedad que afecte progresivamente a su capacidad para hablar.

Para crear una voz con Personal Voice, los usuarios solo tendrán que leer una serie de frases aleatorias para grabar 15 minutos de audio en el iPhone o el iPad. Esta prestación orientada al habla utilizará el aprendizaje automático del dispositivo para mantener la información personal a buen recaudo con una integración perfecta con Live Speech, por lo que los usuarios podrán acudir a ella cuando se comuniquen con sus seres queridos.1

«Al final, lo más importante es poder comunicarse con familiares y amigos», ha dicho Philip Green, activista e integrante de la junta directiva de la organización sin ánimo de lucro Team Gleason y cuya voz ha experimentado cambios considerables desde que le diagnosticaron ELA en 2018. «Decirles que los quieres con una voz similar a la tuya supone una gran diferencia y tener la posibilidad de crear una voz sintetizada en solo 15 minutos con el iPhone es algo extraordinario».

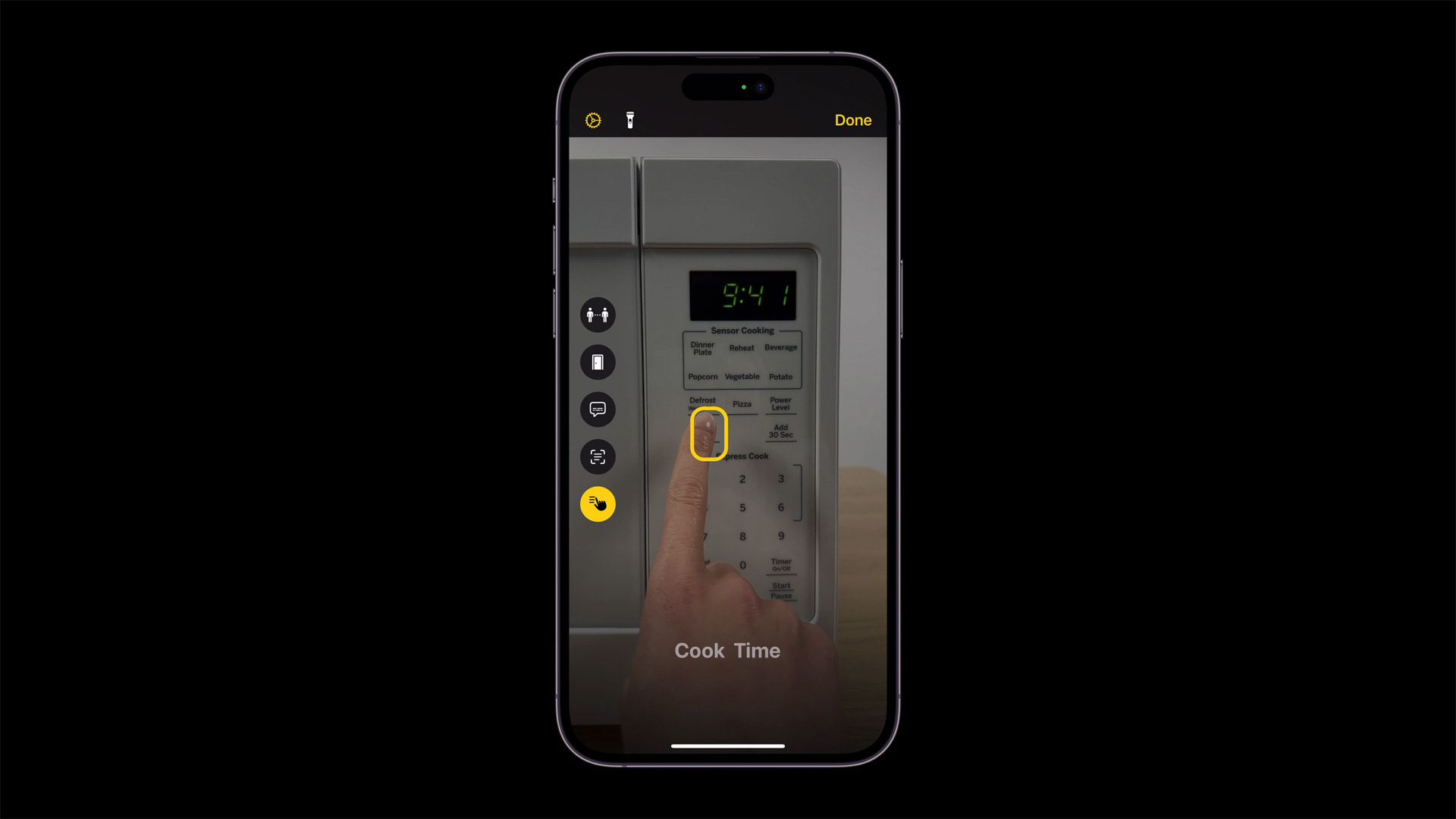

Point and Speak en el modo de detección de Lupa para usuarios ciegos o con visión reducida

Point and Speak en la app Lupa facilita a los usuarios con discapacidades visuales la interacción con el texto presente en objetos físicos. Por ejemplo, al usar un electrodoméstico como un microondas, Point and Speak combinará la información obtenida por la cámara, el escáner LiDAR y el aprendizaje automático del dispositivo para leer en voz alta el texto de los botones a medida que un usuario pasa el dedo por ellos.2 Point and Speak estará integrada en la app Lupa del iPhone y el iPad y funciona en perfecta sincronía con VoiceOver, pudiéndose utilizar junto con otras prestaciones de Lupa, como Detección de personas, Detección de puertas y Descripciones de Imágenes, para ayudar a los usuarios a desplazarse en cada entorno.

Point and Speak en la app Lupa facilita a los usuarios con discapacidades visuales la interacción con el texto presente en objetos físicos.

Otras prestaciones

- Los usuarios sordos o con pérdida de audición pueden enlazar audífonos Made for iPhone directamente con el Mac y personalizarlos como les resulte más cómodo.3

- Control por Voz añade sugerencias fonéticas para que los usuarios que escriben con la voz puedan elegir la palabra que mejor encaja entre varias que suenan de forma parecida.4 Además, con la guía de Control por Voz, los usuarios pueden recibir consejos para usar comandos de voz en vez de tocar la pantalla y teclear en el iPhone, el iPad y el Mac.

- Los usuarios con discapacidades físicas y motoras que utilizan Control por Botón pueden convertir cualquier botón en un mando virtual con el que disfrutar de sus juegos favoritos en el iPhone y el iPad.

- Tamaño del Texto se lo pone más fácil a los usuarios con visión reducida para cambiar los ajustes de esta prestación en apps del Mac como el Finder, Mensajes, Mail, Calendario y Notas.

- Los usuarios sensibles a los movimientos rápidos pueden pausar automáticamente las imágenes animadas, como los archivos GIF, en Mensajes y Safari.

- Las voces de Siri suenan naturales y expresivas incluso a gran velocidad para los usuarios de VoiceOver, que pueden ajustar la rapidez con la que quieren que Siri les hable entre x0,8 y x2.